- Как выбрать лучший способ обучения GAN: сравнение методов WGAN и LSGAN

- Что такое WGAN и как он работает?

- Ключевые особенности WGAN

- Недостатки WGAN

- LSGAN: идея и реализация

- Ключевые особенности LSGAN

- Недостатки LSGAN

- Сравнительная таблица: WGAN vs LSGAN

- Когда и где лучше использовать WGAN или LSGAN?

- Практические советы по внедрению и настройке

- Дополнительные ресурсы и материалы для самостоятельного обучения

Как выбрать лучший способ обучения GAN: сравнение методов WGAN и LSGAN

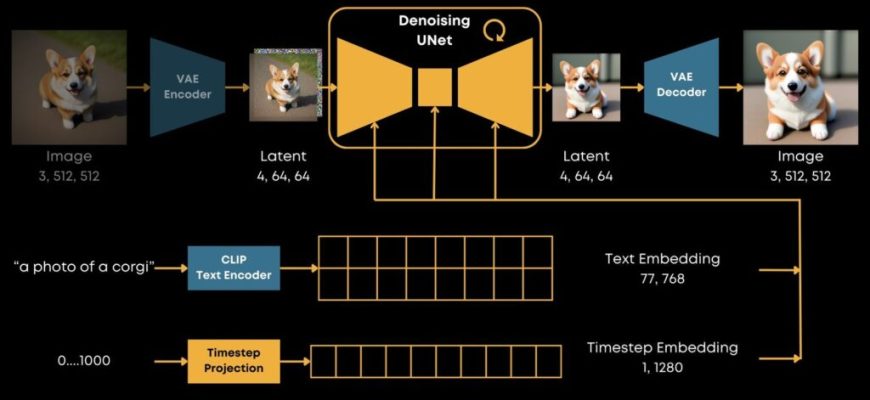

В последние годы генеративные состязательные сети (Generative Adversarial Networks‚ GAN) стали одними из самых популярных инструментов в области искусственного интеллекта и компьютерного зрения. Они позволяют создавать реалистичные изображения‚ видео‚ музыку и не только. Однако эффективность и качество сгенерированных данных во многом зависит от правильно подобранных методов обучения. Именно поэтому особенно важно понимать различия между различными подходами‚ такими как WGAN и LSGAN‚ а также их преимущества и недостатки.

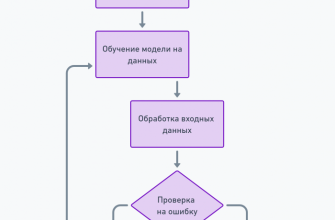

Когда речь идет о генеративных моделях‚ традиционный подход ─ использование классической функции потерь и стандартной оценки‚ иногда приводит к нестабильности процесса обучения и низкому качеству результата. Именно поэтому появились усовершенствованные методы‚ которые помогают стабилизировать процесс и добиться более высокого качества сгенерированных данных. В этой статье мы подробно сравним два таких метода — Wasserstein GAN (WGAN) и Least Squares GAN (LSGAN). Вы узнаете‚ чем они отличаются‚ какие преимущества предлагают и в каких случаях рекомендуется применять каждый из методов.

Что такое WGAN и как он работает?

Wasserstein GAN (WGAN) был предложен как решение основных проблем классических GAN‚ таких как «затухающие градиенты» и нестабильное обучение. Главная идея WGAN — использовать расстояние Wasserstein‚ также известное как «функцию стоимости» или «протяженность»‚ для измерения разницы между распределениями реальных и генерируемых данных.

Преимущество этого подхода в том‚ что расстояние Wasserstein является более стабильным и гладким по сравнению с классической функцией потерь в обычных GAN. Это позволяет обучать модель даже в случаях‚ когда оригинальные GAN сталкиваются с трудностями‚ такими как исчезновение градиентов или коллапс режима.

Вопрос: Почему Wasserstein расстояние считается более подходящим для обучения генеративных моделей по сравнению с классической функцией потерь?

Ответ: Потому что Wasserstein расстояние измеряет разницу между распределениями в более стабильной и информативной форме‚ что позволяет градиентам оставаться ненулевыми даже при очень малых расхождениях‚ тем самым улучшая стабилизацию обучения и качество генерируемых данных.

Ключевые особенности WGAN

- Использование критика (дискриминатора): вместо обычного классификатора‚ критик оценивает расстояние Wasserstein между реальным и сгенерированным распределением.

- Лемма Канта-Шорти: внедрение ограничения Липшица на функцию критика для обеспечения корректности расстояния Wasserstein — обычно достигается с помощью градиентных клэмпов.

- Обучение: более стабильно‚ даже при использовании больших архитектур или на сложных данных.

- Преимущество в том‚ что: при обучении критик не ограничен дискретной классификацией‚ а измеряет «расстояние» между распределениями‚ что уменьшает проблему коллапса режима.

Недостатки WGAN

- Требует более сложных методов ограничения Липшица‚ таких как градиентный клэмп или использование взвешенных штрафов.

- Может быть менее чувствительным к мелким деталям‚ по сравнению с классическими GAN.

- Необходимость более тщательной настройки гиперпараметров‚ особенно связанных с ограничениями функции критика.

LSGAN: идея и реализация

LSGAN (Least Squares GAN) — это модификация классической GAN‚ основанная на использовании функции потерь с квадратичным (линейным) штрафом; Основная идея заключается в том‚ чтобы минимизировать среднюю квадратичную ошибку между реальными и сгенерированными образами‚ что способствует более плавному и стабильному обучению модели.

Преимущество LSGAN в том‚ что он минимизирует среднюю ошибку‚ аналогично стандартным задачам регрессии‚ что позволяет избежать проблем‚ связанных с исчезающими градиентами‚ типичных для оригинальной функции перекрестной энтропии в GAN.

Вопрос: Какие преимущества дает использование квадратичной функции потерь в LSGAN относительно традиционной функции потерь в классическом GAN?

Ответ: Она обеспечивает более плавное обучение и уменьшает проблему исчезающих градиентов‚ способствует стабилизации процесса и позволяет получать более качественные и разнообразные сгенерированные данные.

Ключевые особенности LSGAN

- Использование квадратичной функции потерь: вместо кросс-энтропии‚ что обеспечивает более стабильное обучение.

- Меньшая чувствительность к коллапсу режима: благодаря более гладкой функции потерь модель лучше обучается и генерирует разнообразные образцы.

- Обучение: при помощи простых методов минимизации средней квадратичной ошибки‚ что облегчает настройку и ускоряет обучение.

Недостатки LSGAN

- Может хуже работать при очень сложных распределениях данных.

- Иногда возникает переобучение модели на «нейтральных» образцах‚ что влияет на качество конечных результатов.

- Не всегда обеспечивает такую же стабильность‚ как WGAN при очень больших масштабах данных.

Сравнительная таблица: WGAN vs LSGAN

| Параметр | WGAN | LSGAN |

|---|---|---|

| Тип функции потерь | Расстояние Wasserstein (Липшиц) | Квадратичная (MSE) |

| Степень стабилизации обучения | Высокая‚ благодаря расстоянию Wasserstein | Средняя‚ зависит от данных и архитектуры |

| Обеспечение разнообразия генерируемых данных | Хорошо‚ предотвращает коллапс режима | Средне‚ возможен феномен переобучения |

| Требования к оптимизации | Ограничение Липшица‚ обычно градиентный клэмпинг | Меньше требований‚ проще в реализации |

| Область применения | Генерация изображений‚ стабилизация обучения | Генерация изображений‚ где важна стабильность |

| Обучение и настройка гиперпараметров | Требует осторожной настройки (локальные ограничения) | Проще‚ но музыкака для группового обучения |

Когда и где лучше использовать WGAN или LSGAN?

Выбор метода обучения зависит от конкретных целей и условий проекта. Если наша главная задача — получить максимально реалистичные изображения с высоким качеством и стабильностью‚ то предпочтительным вариантом станут WGAN или его улучшенные версии. Благодаря использованию расстояния Wasserstein‚ модель лучше справляется с большими и сложными распределениями‚ предотвращая распространенные проблемы традиционных GAN.

В случаях‚ когда важна скорость и легкость реализации‚ а также при меньших масштабах данных‚ зачастую лучше подойдет LSGAN — он проще в настройке и зачастую достаточно стабилен в процессе обучения. Также стоит учитывать‚ что LSGAN хорошо подходит для задач‚ где важна полнота и разнообразие генерируемых данных‚ а также когда требуется чуть меньшая чувствительность к ошибкам режима.

Вопрос: Какие критерии помогут выбрать между WGAN и LSGAN для моего проекта?

Ответ: Если приоритет — получение максимально высокого качества изображений и стабильность обучения при работе с большими данными‚ лучше выбрать WGAN. Если же важна простота реализации‚ быстрота обучения и умеренная стабильность‚ то LSGAN будет хорошим выбором.

Практические советы по внедрению и настройке

- Для WGAN: убедитесь‚ что функция критика ограничена по Липшицу — используйте градиентный клэмпинг или ваевские штрафы. Также внимательно настройте параметры обучения‚ такие как частота обновления критика и генератора.

- Для LSGAN: начинайте с классических расчетов средней квадратичной ошибки‚ постепенно регулируя гиперпараметры. Внимательно следите за количеством эпох и качеством промежуточных изображений.

- Общий совет: проводите постоянную валидацию модели и экспериментируйте с архитектурой сети. Стремитесь к балансированию сложности модели и объема данных.

Нельзя недооценивать роль теоретических знаний при выборе метода обучения GAN. Однако даже самый лучший теоретический подход не заменит опыта и экспериментов в конкретных условиях вашего проекта. Важно понять‚ что оба метода — WGAN и LSGAN, имеют свои сильные стороны и ограничения‚ их успешное использование зависит от задачи‚ ресурсов и целей. Вовремя проведенные эксперименты помогут определить‚ какой из методов наиболее подходит именно вам.

Обучение генеративных моделей — это всегда баланс командных усилий‚ данных и вычислительных ресурсов. Теоретическая подготовка и практический опыт позволяют сделать правильный выбор и добиться отличных результатов в создании реалистичных и инновационных решений.

Дополнительные ресурсы и материалы для самостоятельного обучения

- Статья о WGAN

- Основы LSGAN

- Обзор функций потерь в машинном обучении

- Реализации GAN на PyTorch

- Практика обучения WGAN в Keras

Подробнее

| WGAN особенности | LSGAN преимущества | Обучение GAN стабилизация | Где применять WGAN и LSGAN | Выбор метода обучения GAN |

| Расстояние Wasserstein | Квадратичная функция потерь | Простота настройки | Обучение стабильное | Анализ задач GAN |

| Обеспечение разнообразия | Меньше требований к оптимизации | Высокая стабильность | Качественные изображения | Настройка гиперпараметров |

| Проблемы обучения | Необходимость ограничения Липшица | Меньше проблем с исчезающими градиентами | Практические советы | Экспериментирование |